梦晨 发自 凹非寺聚色阁

量子位 | 公众号 QbitAI腾讯拿出看家才能,来挤开源赛说念,倏得发布了市面上最大的开源MoE模子。

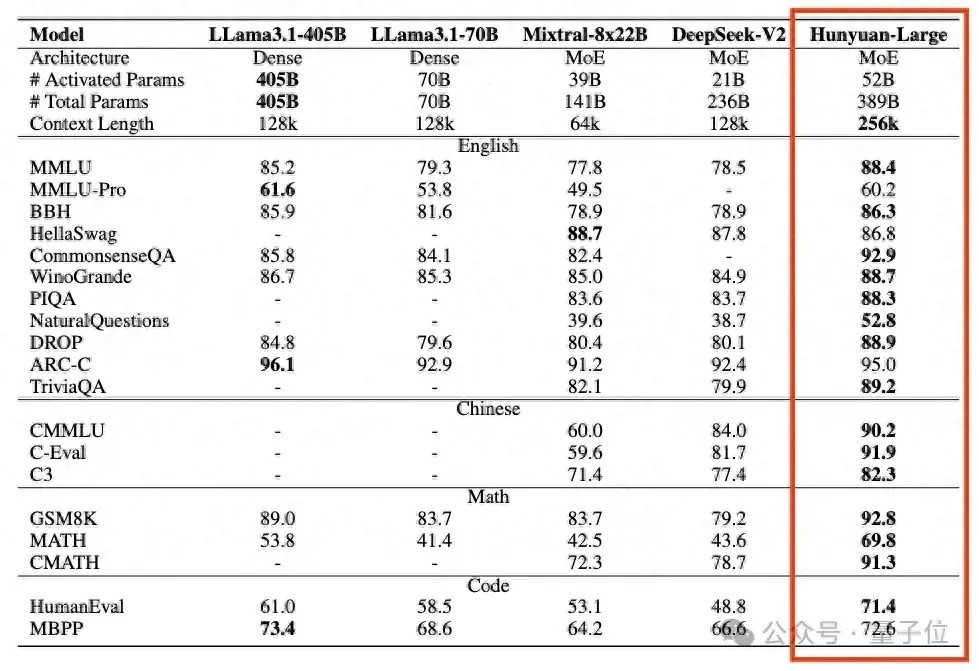

Hunyuan-Large,3890亿总参数,520亿激活参数。

跑分卓越Llama 3.1 405B等开源旗舰,高下文长度因循也向上一档来到256k。

天然Hunyuan-Large还不算腾讯里面的旗舰模子,但腾讯先容底层本领与混元大模子“同宗同源”:

好多细节都是里面业务打磨好再开源出来的,比如用到了腾讯元宝App的AI长文阅读等功能里。

当今这么的一个模子透彻开源,免费可商用,算是很有丹心了。

此次腾讯Hunyuan-Large悉数开源了三个版块:预历练模子、微调模子、FP8量化的微调模子。

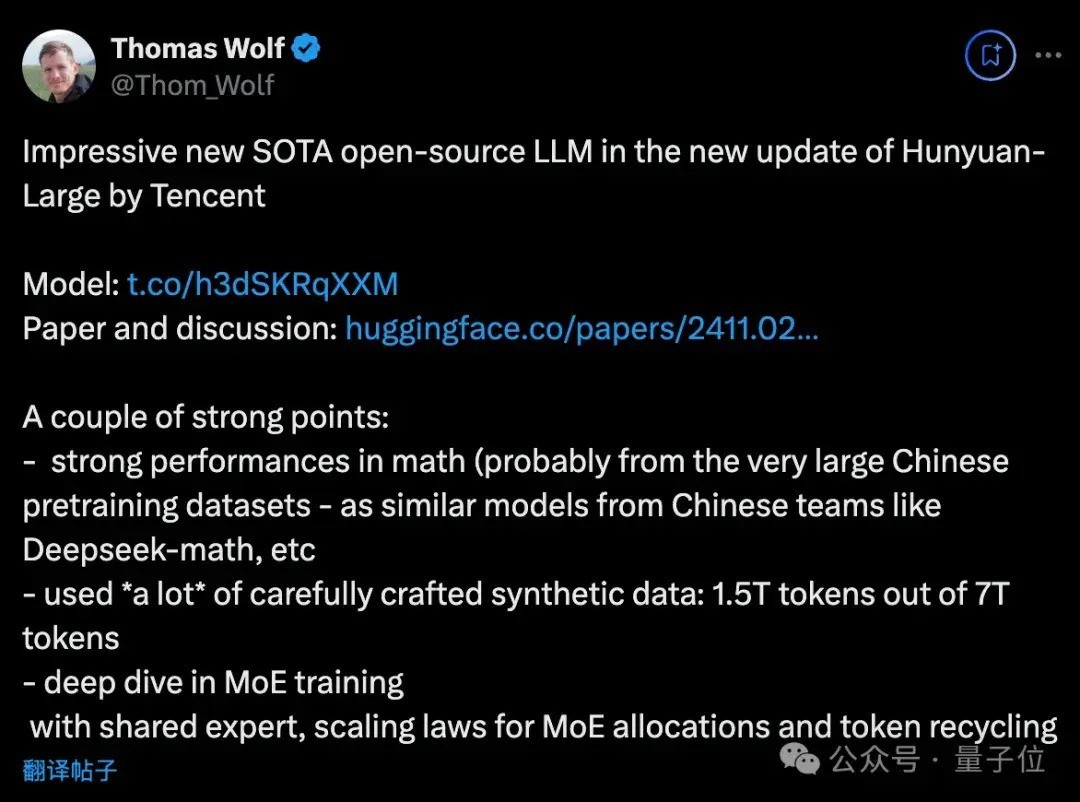

在开源社区掀翻一阵热议,HuggingFace首席科学家Thomas Wolf墙裂推选并回想了几个亮点。

数学才能很强用了好多全心制作的合成数据长远探索了MoE历练,使用分享群众、回想了MoE的Scaling Law。

各路征战者中,有立马运转下载部署的脱手派,也有东说念主但愿腾讯入局后,开源模子卷起来能迫使Meta造出更好的模子。

此次腾讯同步发布了本领诠释,其中好多本领细节也引起商讨。

如蓄意了MoE的Scaling Law公式,C ≈ 9.59ND + 2.3 ×108D。

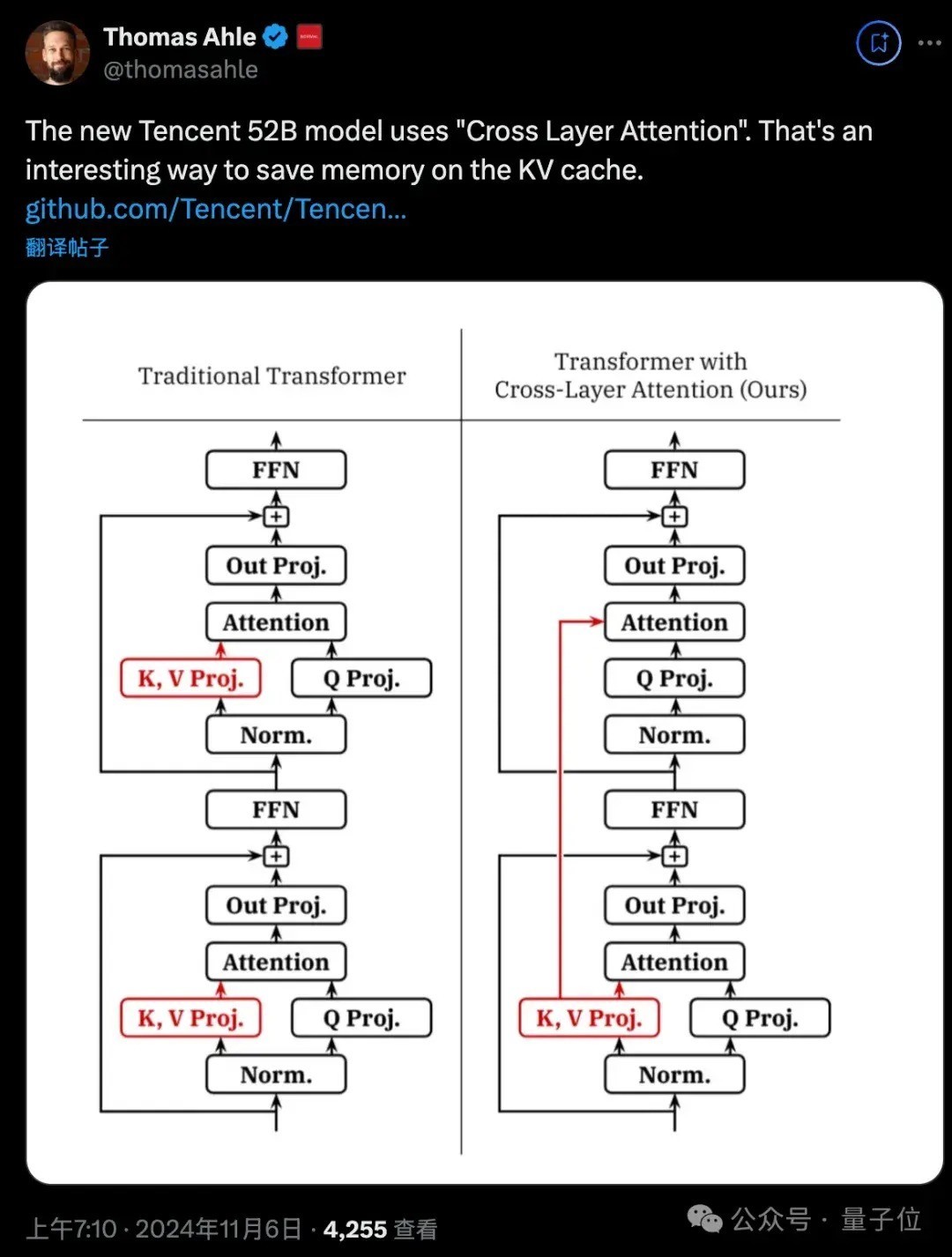

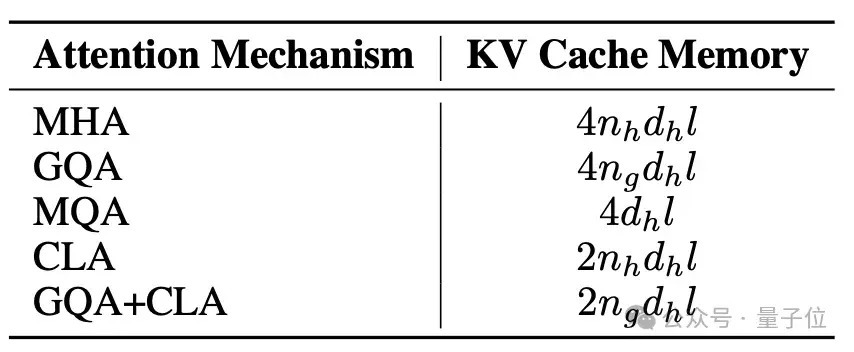

又比如用交叉层注倡导勤俭KV缓存的内存占用。

底下奉上发布会现场演斗殴本领诠释精华内容回想。

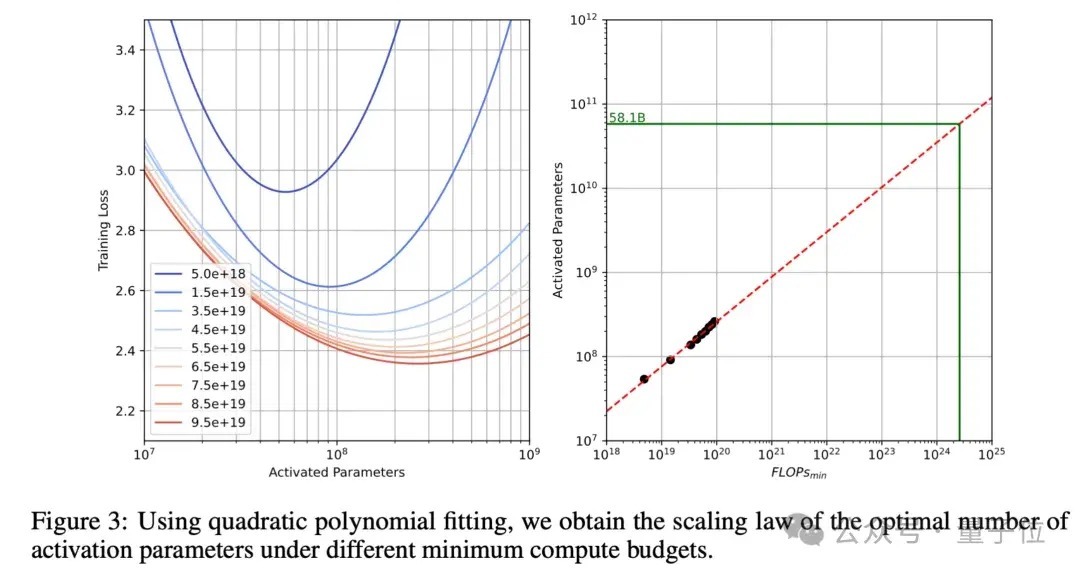

Hunyuan-Large本领诠释MoE的Scaling Law告成上公式:

C ≈ 9.59ND + 2.3 × 108D

其中C暗示蓄意预算(单元FLOPs),N暗示激活参数数目,D暗示历练数据量(单元tokens)。

与传统密集模子的蓄意预算公式C=6ND比较,MoE模子公式的各别主要体当今两个方面:

一是系数从6增多到9.59,反应了MoE非凡的路由蓄意支出,包含群众切换的蓄意资本。

二是增多了常数项2.3×108D,反应了长序列MoE模子attention蓄意的非凡支出。

为了详情最优激活参数目聚色阁,团队参预大都资本张开实验:

历练一系列激活参数范围从10M到1B的模子,使用最高1000亿tokens的历练数据,笼罩100亿到1000亿tokens的不同数据范畴。

使用isoFLOPs弧线,在固定蓄意预算下寻找最优点,同期研讨履行历练batch size的影响,分析不同参数目和数据量的组合,蓄意得出最优激活参数目约为58.1B。

而最终Hunyuan-Large接管了52B的激活参数目,主要研讨到最优点隔邻弧线平滑,在58.1B隔邻有较大容差空间,以及蓄意资源管理、历练踏实性要乞降部署后果平衡等膨胀要素。

路由和历练计谋

除了揭秘最优参数配比,本领诠释中还详解了Hunyuan-Large专有的”MoE心法”。

夹杂路由计谋:

Hunyuan-Large禁受分享群众(shared expert)和极度群众(specialized experts)相联结的夹杂路由。

每个token激活1个分享群众和1个有益群众,分享群众惩处系数token的通用常识,而极度群众则用top-k路由计谋动态激活,精致惩处任务关系的极度才能。

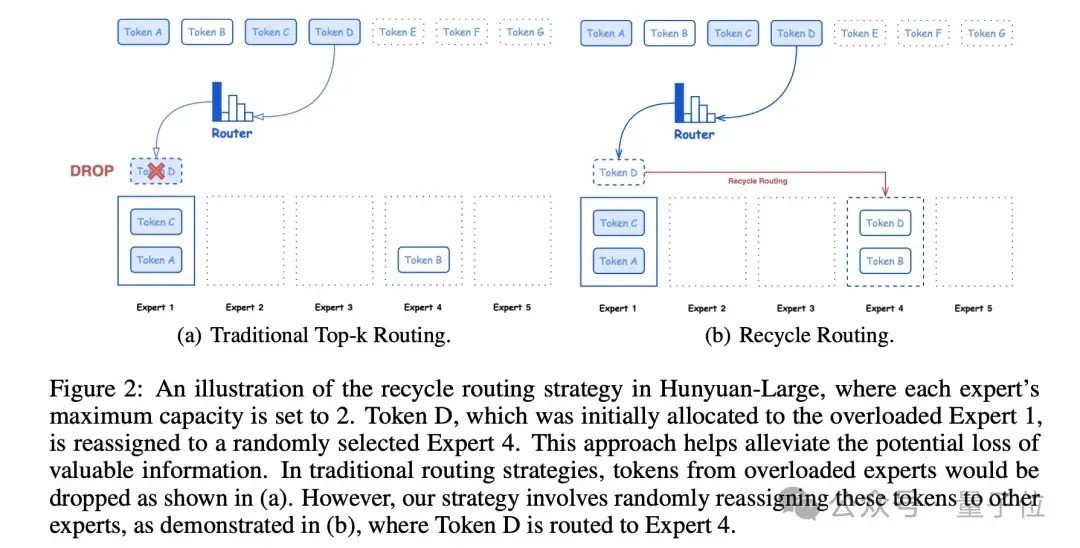

回收路由计谋:

传统MoE常因群众超载而丢弃过多tokens。Hunyuan-Large想象了群众回收机制,保执相对平衡的负载,充分哄骗历练数据,保证模子的历练踏实性和管理速率。

群众特定学习率适配计谋:

不同群众承载的tokens各别雄壮,应设定不同学习率,如分享群众使用较大的学习率,确保每个子模子有用地从数据中学习并有助于全体性能。

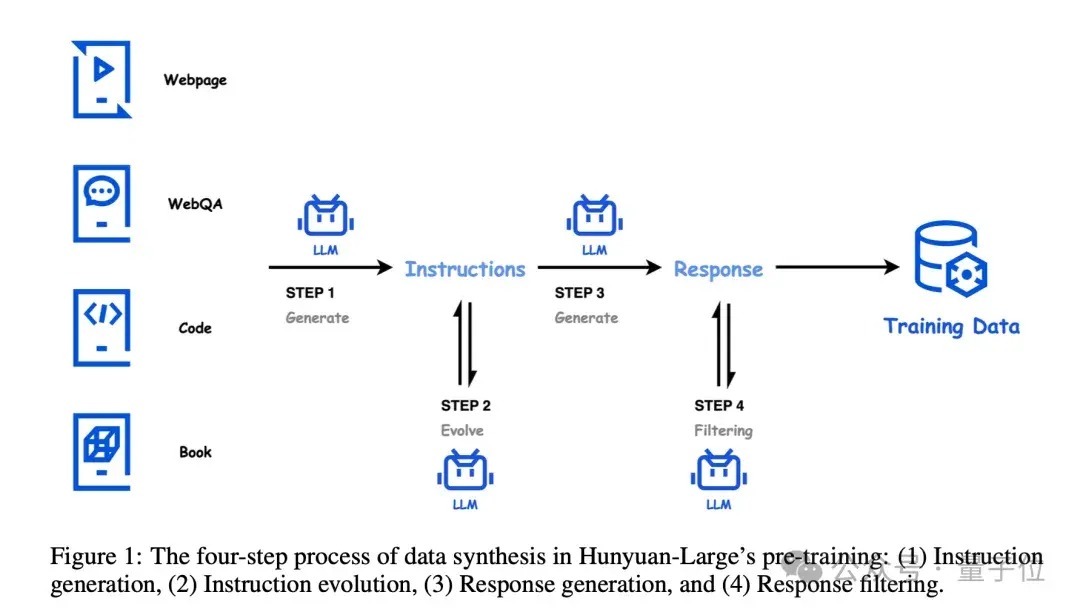

高质地合成数据混元团队征战了一套齐全的高质地数据合成进程,主要包括四个要领:请示生成、请示进化、回答生成和回答过滤。

在请示生成阶段,混元团队使用高质地的数据源行动种子,笼罩多个范畴和不同复杂度,确保请示的各种性和全面性。

接下来是请示演化阶段,通过晋升请示的明晰度和信息量,扩充低资源范畴的请示,并逐渐晋升请示的难度,使得请示愈加丰富、精确和具有挑战性。

在回答生成阶段,混元团队禁受有益的模子针对不同范畴生成专科的谜底。这些模子在范畴和想象上各有不同,以确保生成的回答大要知足不同范畴的条款。

临了是回答过滤阶段,混元团队禁受critique模子对生成的回答进行质地评估,并进行自一致性查抄,以确保输出的谜底是高质地的。

通过这四步合成进程,混元团队大要生成大都高质地、各种化的请示-回答数据对,为MoE模子的历练提供了丰富、优质的数据因循。

这种数据合成方法不仅提高了模子的历练后果,也极地面促进了模子在多种下贱任务上的发挥。

长文才能优化为了完了强盛的长文本惩处才能,混元团队在历练过程中禁受了多项计谋。

最初是分阶段历练,第一阶段惩处32K tokens的文本,第二阶段将文本长度扩展至256K tokens。在每个阶段,都使用约100亿tokens的历练数据,确保模子大要充分学习和允洽不同长度的文本。

在历练数据的接管上,25%为天然长文本,如册本、代码等,以提供着实的长文本样本;其余75%为闲居长度的数据。这种数据组共计谋确保了模子在取得长文交融才能的同期,也能保执在闲居长度文本上的基础惩处才能。

此外,为了更好地惩处超长序列中的位置信息,混元团队对位置编码进行了优化。他们禁受了RoPE位置编码方法,并在256K tokens阶段将base frequency扩展到10亿。这种优化风光大要有用地惩处超长序列中的位置信息,晋升模子对长文本的交融和生成才能。

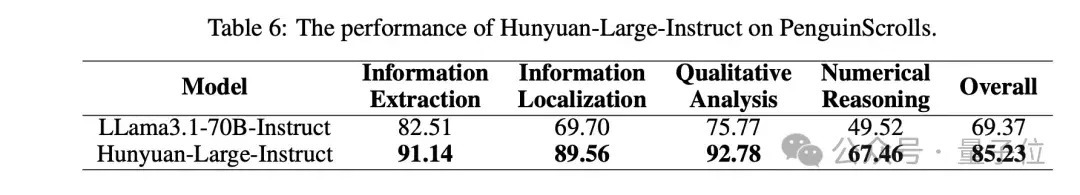

除了在公开数据集上进行评测,混元团队还征战了一个名为”企鹅卷轴”的长文本评测数据集。

“企鹅卷轴”包含四个主要任务:信息抽取、信息定位、定性分析和数值推理。

不同于现存的长文本基准测试,”企鹅卷轴”有以下几个上风:

数据各种性:”企鹅卷轴”包含了各式着实场景下的长文本,如财务诠释、法律文档、学术论文等,最长可达128K tokens。任务全面性:数据集涵盖了多个难度脉络的任务,构建了一个全面的长文本惩处才能分类体系。对话数据:引入了多轮对话数据,模拟着实的长文本问答场景。多话语因循:提供中英双语数据,知足多话语应用需求。推理加快优化为了进一步晋升Hunyuan-Large的推理后果,混元团队禁受了多种优化本领,其中最要道的是KV Cache压缩。

主要联结了两种方法:GQA(Grouped-Query Attention)和CLA(Cross-Layer Attention)。

GQA通过成就8个KV head组,压缩了head维度的KV cache;而CLA则通过每2层分享KV cache,压缩了层维度的内存占用。

通过这两种计谋的组合,混元MoE模子的KV cache内存占用裁汰了约95%,而模子性能基本保执不变。这种显耀的内存优化不仅大幅晋升了推理后果,也使得模子更易于部署,适配各式履行应用场景。

后历练优化

预历练的基础上,混元团队禁受了两阶段的后历练计谋,包括监督微调(SFT)和东说念主类反馈强化学习(RLHF),以进一步晋升模子在要道范畴的才能和东说念主类对王人进程。

在SFT阶段,混元团队使用了卓越100万条高质地数据,笼罩了包括数学、推理、问答、编程等多个要道才能范畴。为了确保数据的高质地,团队禁受了多重质地放手措施,包括范例筛选、模子筛选和东说念主工审核。通盘SFT过程分为3轮,学习率从2e-5衰减到2e-6,以充分哄骗数据,同期幸免过拟合。

撸撸色在RLHF阶段,混元团队主要禁受了两阶段离线和在线DPO联结。离线历练使用事先构建的东说念主类偏好数据集,以增强可控性;在线历练则哄骗刻下计谋模子生成多个回应,并用奖励模子选出最好回应,以提高模子的泛化才能。

同期,他们还使用了指数滑动平均计谋,缓解了reward hacking问题,确保了历练过程的安详和管理。

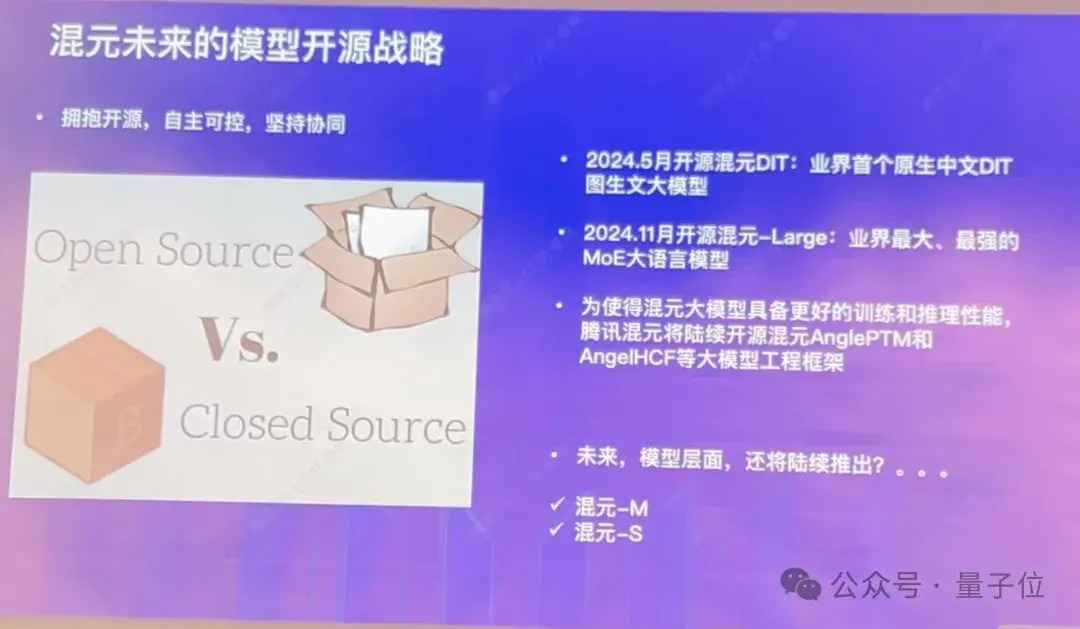

One More Thing在发布会现场,腾讯混元大模子算法精致东说念主康战辉还线路,Hunyuan-Large之后,还会研讨逐渐开源中微型号的模子,允洽个东说念主征战者、旯旮侧征战者的需求。

另外腾讯同期开源的3D大模子可移步这里了解。

官网:

https://llm.hunyuan.tencent.com/Github地址:https://github.com/Tencent/Tencent-Hunyuan-LargeHugging Face 地址:https://huggingface.co/tencent/Tencent-Hunyuan-Large参考汇集:

[1]https://x.com/Thom_Wolf/status/1853694513585303771— 完 —

量子位 QbitAI · 头条号签约

温雅咱们聚色阁,第一时期获知前沿科技动态